Agentes IA: ¿Qué es un Agente de Inteligencia Artificial?

- Dacadev

- Generative ai

- May 15, 2026

Tabla de Contenido

En el mundo de la Inteligencia Artificial, los términos aparecen y se mezclan con una velocidad que a veces marea. Uno de los conceptos más poderosos —y más incomprendidos— es el de Agente de IA. Seguro has escuchado el término, pero ¿qué significa realmente? ¿Qué hace que un sistema deje de ser un simple chatbot y se convierta en un agente capaz de percibir, razonar y actuar sobre su entorno?

Note

En este artículo aprenderás qué es un agente de IA desde su definición formal, cómo un LLM actúa como su “cerebro”, y los módulos fundamentales que lo potencian: memoria, herramientas y planificación. 🚀

Definición formal de un Agente

An agent is anything that can be viewed as perceiving its environment through sensors and acting upon that environment through actuators.

Russell & Norvig, AI: A Modern Approach

Podemos descomponer esta definición en los componentes fundamentales que están en el corazón de todo agente:

- Environment (Entorno): El mundo con el que el agente interactúa

- Sensors (Sensores): Componentes que el agente usa para observar su entorno

- Actuators (Actuadores): Herramientas que el agente usa para actuar sobre el entorno

- Effector (Efector): El “cerebro” o las reglas que deciden cómo pasar de observaciones a acciones

flowchart LR

E[🌍 Entorno] -->|percibe| S[📡 Sensores]

S -->|observaciones| EF[🧠 Efector]

EF -->|decisiones| A[🔧 Actuadores]

A -->|actúa sobre| E

Imagina un robot aspiradora: sus sensores detectan obstáculos y suciedad (entorno), su “cerebro” decide qué dirección tomar (efector), y sus motores y cepillos ejecutan la acción (actuadores). Un agente de IA funciona con la misma lógica, pero en un entorno digital.

El Agente basado en LLM

En la práctica, el Efector o cerebro del agente tiende a ser un LLM con capacidad de razonamiento. A través de módulos adicionales —memoria, herramientas y planificación— este LLM es capaz de interactuar con su entorno.

- Los Actuadores son las herramientas del LLM (APIs, funciones, búsquedas)

- Los Sensores son las capacidades multimodales del LLM (texto, imágenes, audio)

- El Usuario forma parte del entorno e influye directamente en cómo se inicia el agente

flowchart TD

U[👤 Usuario] -->|prompt| LLM[🧠 LLM - Cerebro del Agente]

LLM -->|usa| T[🔧 Herramientas / Tools]

LLM -->|consulta| M[💾 Memoria]

LLM -->|genera| P[📋 Plan]

T -->|resultados| LLM

M -->|contexto| LLM

P -->|siguiente paso| LLM

LLM -->|respuesta| U

T -->|modifica| ENV[🌍 Entorno Digital]

ENV -->|datos| LLM

Sin ninguna interacción del usuario, el LLM no tomará ninguna acción. El agente está fuertemente influenciado por cómo el usuario inicia la conversación.

Large Language Models (LLMs)

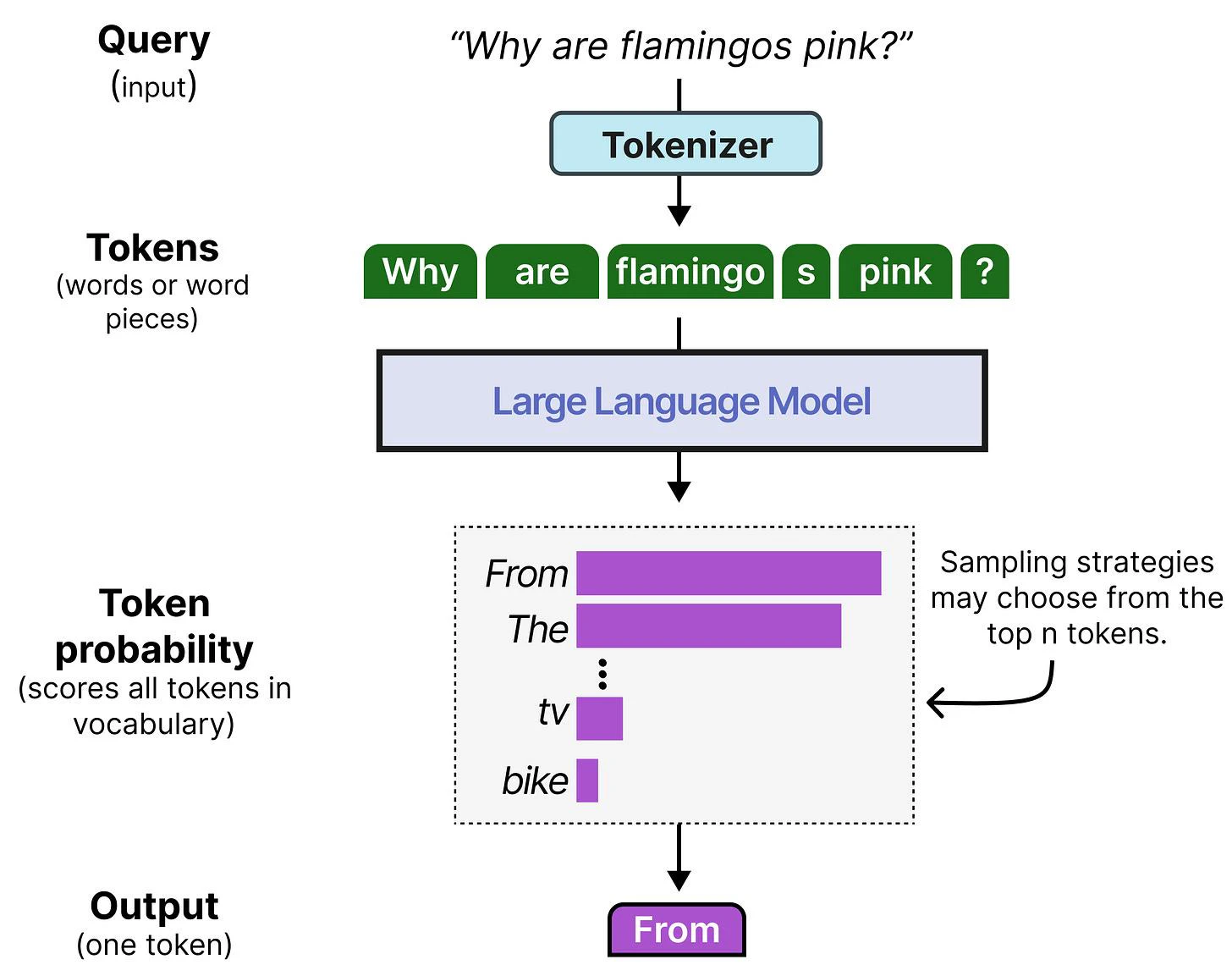

El LLM es considerado el “cerebro” del agente. Tradicionalmente, un LLM es un modelo que no hace más que predecir la siguiente palabra basándose en un texto de entrada.

Tokenización

El LLM primero descompone la consulta de entrada en tokens, que son sub-componentes de palabras que permiten al modelo generalizar a palabras que no ha visto antes. El modelo procesa estos tokens y hace una predicción sobre cuál podría ser el siguiente.

Autoregresión

El LLM predice el siguiente token, usa ese token predicho para actualizar su entrada, y luego continúa las predicciones. Al hacer esto de forma iterativa —lo que se llama autoregresión— puede crear respuestas completas a la consulta del usuario.

sequenceDiagram

participant Input as Texto de entrada

participant LLM as LLM

participant Output as Texto generado

Input->>LLM: "El gato está"

LLM->>Output: "sentado"

Note over Input,Output: Se agrega al input

Input->>LLM: "El gato está sentado"

LLM->>Output: "en"

Note over Input,Output: Se agrega al input

Input->>LLM: "El gato está sentado en"

LLM->>Output: "la silla"

Note over Output: Respuesta completa generada

Cada predicción se alimenta de las anteriores, construyendo la respuesta palabra por palabra.

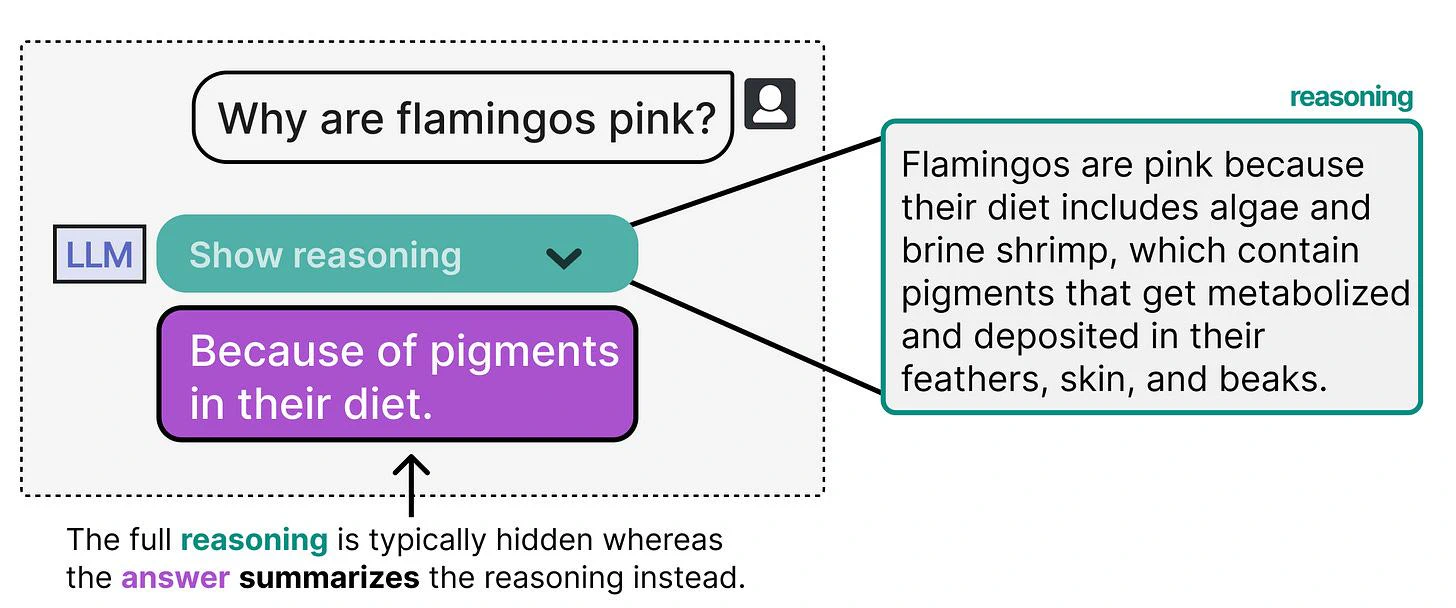

LLMs con Razonamiento

El campo de los agentes de IA descubrió que las capacidades de los LLMs aumentarían sustancialmente si pudieran razonar. En lugar de que el modelo “piense” en silencio (a través de sus parámetros internos), ahora se entrenan para “pensar en voz alta” generando trazas de razonamiento antes de derivar la respuesta.

flowchart LR

Q[📝 Consulta del usuario] --> T[💭 Pensamientos / Razonamiento]

T --> R[✅ Respuesta final]

La idea principal es que al escribir sus pensamientos primero mediante su comportamiento autoregresivo, el LLM puede dedicar cómputo adicional a estructurar su razonamiento antes de generar la respuesta. Como los humanos, al estructurar sus pensamientos, las consultas complejas que requieren razonamiento multi-paso son más fáciles de resolver.

Tip

En la práctica, estos “pensamientos” están ocultos para el usuario. La respuesta que ves generalmente representa un resumen del razonamiento interno del modelo.

Ejemplo de razonamiento

Veamos cómo un LLM con razonamiento aborda un problema complejo:

El modelo genera una cadena de pensamientos internos, evalúa opciones y finalmente produce una respuesta bien fundamentada.

Aumentando las capacidades del LLM

Aunque los LLMs con razonamiento son vitales para los agentes de IA, siguen siendo incompletos. Como entidades estáticas de texto-a-texto, los LLMs no tienen control sobre su entorno, ni recuerdan sus interacciones, ni aprenden de ellas.

Para convertir un LLM en un verdadero agente, necesitamos proveerlo de tres módulos fundamentales:

flowchart TD

LLM[🧠 LLM con Razonamiento]

MEM[💾 Memoria]

TOOLS[🔧 Herramientas]

PLAN[📋 Planificación y Reflexión]

MEM --> LLM

TOOLS --> LLM

PLAN --> LLM

LLM --> AGENT[🤖 Agente de IA]

Memoria

Sin memoria, los LLMs operan en conversaciones de “single-turn”: una sola pregunta y una sola respuesta. La información no persiste entre llamadas.

sequenceDiagram

participant U as Usuario

participant L as LLM

U->>L: ¿Cuál es la capital de Francia?

L->>U: París

Note over U,L: ❌ Sin contexto previo

U->>L: ¿Y su población?

L->>U: ¿De qué ciudad hablas?

Note over L: No recuerda la conversación anterior

Afortunadamente, hay muchas formas de agregar módulos de memoria. La forma más común es simplemente añadir la conversación previa al prompt actual:

sequenceDiagram

participant U as Usuario

participant M as Memoria

participant L as LLM

U->>L: ¿Cuál es la capital de Francia?

L->>U: París

L->>M: Guardar contexto

U->>L: ¿Y su población?

M->>L: Contexto: hablamos de París

L->>U: París tiene ~2.1 millones de habitantes

Note over L: ✅ Recuerda el contexto

Warning

Los módulos de memoria pueden ser complejos. Si recibimos demasiada información, se vuelve difícil de procesar, lo que puede llevar a malas decisiones. Esto se llama sobrecarga de información y es un problema real incluso para los LLMs. Se necesita un balance entre la cantidad y calidad de la información en el prompt — esto es lo que se conoce como context engineering.

Los sistemas de memoria comparten similitudes con nuestros sistemas de memoria humana:

- Memoria a corto plazo: La conversación actual, las últimas interacciones

- Memoria a largo plazo: Hechos persistentes, preferencias del usuario, conocimiento acumulado

Herramientas (Tools)

Con la memoria, los LLMs recuerdan sus conversaciones previas, pero aún no son capaces de interactuar con su entorno. Los LLMs pueden interactuar con su entorno digital a través de herramientas externas que amplían sus capacidades: calculadoras, motores de búsqueda, APIs, shells de comandos, y más.

Sin embargo, los LLMs no son capaces de usar herramientas por sí mismos. Fundamentalmente, un LLM es una función de texto-entrada/texto-salida. Solo puede describir o expresar la intención de tomar una acción.

sequenceDiagram

participant U as Usuario

participant L as LLM

participant R as Runtime / Orquestador

participant T as Herramienta

U->>L: ¿Cuánto es 847 × 392?

L->>R: {"tool": "calculator", "params": {"expr": "847 * 392"}}

Note over L,R: El LLM expresa INTENCIÓN

R->>T: Ejecutar cálculo

T->>R: 331,824

R->>L: Resultado: 331,824

L->>U: El resultado es 331,824

Info

El LLM puede expresar la intención de usar una herramienta, pero depende de nosotros convertir esa intención en una llamada real. Necesitamos escribir software que interprete el output del LLM (generalmente JSON) para elegir la herramienta correcta y completar sus parámetros.

Las herramientas varían en complejidad:

- Simples: Calculadoras, conversor de unidades

- Intermedias: Búsqueda web, consultas a bases de datos

- Complejas: Acceso a terminal, entornos de código, APIs de GitHub

Planificación y Reflexión

El ingrediente final para ir de un LLM “regular” a un Agente de IA es su capacidad de planificar y reflexionar. Estas capacidades son fundamentales, ya que el agente necesita decidir qué pasos tomar, cómo tomarlos y cuándo.

Descomposición de tareas

Aquí es donde entra la planificación: descomponer una tarea grande en pasos más pequeños y ejecutables. Esto se conoce como task decomposition.

flowchart TD

Q[📝 Query: Investiga papers recientes sobre RAG] --> P[📋 Plan]

P --> T1[1. Buscar en Google Scholar]

P --> T2[2. Buscar en ArXiv]

P --> T3[3. Filtrar por fecha 2024-2025]

P --> T4[4. Leer abstracts relevantes]

P --> T5[5. Generar resumen comparativo]

T1 --> E[⚡ Ejecución secuencial]

T2 --> E

T3 --> E

T4 --> E

T5 --> E

Ejecución iterativa con razonamiento

Al referirse continuamente a su plan, el LLM ejecuta cada tarea una por una. Hacerlas todas a la vez rara vez es eficiente, ya que cada tarea puede influir en otra. Después de completar una tarea específica, el LLM razona sobre qué pasos tomar a continuación.

flowchart TD

START[🎯 Objetivo] --> PLAN[📋 Crear Plan]

PLAN --> EXEC[⚡ Ejecutar Tarea]

EXEC --> REASON[🤔 Razonar sobre resultado]

REASON -->|siguiente tarea| EXEC

REASON -->|plan completo| DONE[✅ Resultado Final]

REASON -->|ajustar plan| REFLECT[🔄 Reflexionar]

REFLECT -->|plan mejorado| PLAN

Reflexión

Crear un plan no es suficiente. El LLM puede descubrir a mitad del camino que algunos pasos no son apropiados. Por ejemplo, podría descubrir que Google y ArXiv son insuficientes y decidir agregar Semantic Scholar y PubMed como recursos adicionales.

Este comportamiento reflexivo hace que los agentes parezcan humanos: intentan descubrir sus fallos y hacer intentos por corregirlos. Al reflexionar sobre comportamiento pasado, el plan inicial puede mejorarse continuamente.

Note

La planificación y reflexión crean un ciclo iterativo: planificar tareas → ejecutar acciones → reflexionar sobre el resultado → ajustar el plan. Este ciclo es lo que diferencia a un verdadero agente de un simple modelo que responde preguntas. 🚀

Conclusión

Un agente de IA no es simplemente un LLM que responde preguntas. Es un sistema compuesto por:

- Un LLM con razonamiento como cerebro central

- Memoria para mantener contexto entre interacciones

- Herramientas para interactuar con el entorno digital

- Planificación y reflexión para abordar tareas complejas de forma iterativa

flowchart TD

subgraph AGENT[🤖 Agente de IA]

direction TB

BRAIN[🧠 LLM con Razonamiento]

MEM[💾 Memoria

Corto y largo plazo]

TOOLS[🔧 Herramientas

APIs, búsqueda, código]

PLAN[📋 Planificación

Descomposición + Reflexión]

MEM <--> BRAIN

TOOLS <--> BRAIN

PLAN <--> BRAIN

end

USER[👤 Usuario] <-->|interacción| AGENT

AGENT <-->|percibe y actúa| ENV[🌍 Entorno]

La próxima vez que interactúes con un asistente de IA que busca información, ejecuta código y ajusta su enfoque basándose en los resultados, estarás interactuando con un agente. Y ahora entiendes la maquinaria que lo hace posible.